1. 개요

NoSQL 데이터를 Azure DataFactory Pipeline을 통해 Private 환경에서 Azure Cosmos DB로 데이터를 적재해야하는 테스트가 필요했다.

2. 내용

- 모든 환경은 Azure에서 Private 환경을 통해서만 진행한다.

- Azure Blob Storage에 csv 파일을 업로드 한 뒤 해당 데이터를 Azure DataFactory Managed Private endpoint를 통해서 Azure Cosmos DB for Nosql에 데이터 적재 테스트 진행한다.

3. 환경 구축

- CSV 파일

파일 내용

id name age city email

1 John Doe 30 New York john@example.com

2 Jane Smith 28 Los Angeles jane@example.com

3 Mike Johnson35 Chicago mike@example.com

4 Sarah Brown 32 Houston sarah@example.com

5 David Lee 29 San Francisco david@example.com

- Azure Cosmos DB for NoSQL 배포 및 구성

서비스 배포 후 Private endpoint 연결 설정 진행

Private endpoint 연결을 진행하여 아래 이미지 처럼 Public하게 접속은 되지 않는다.

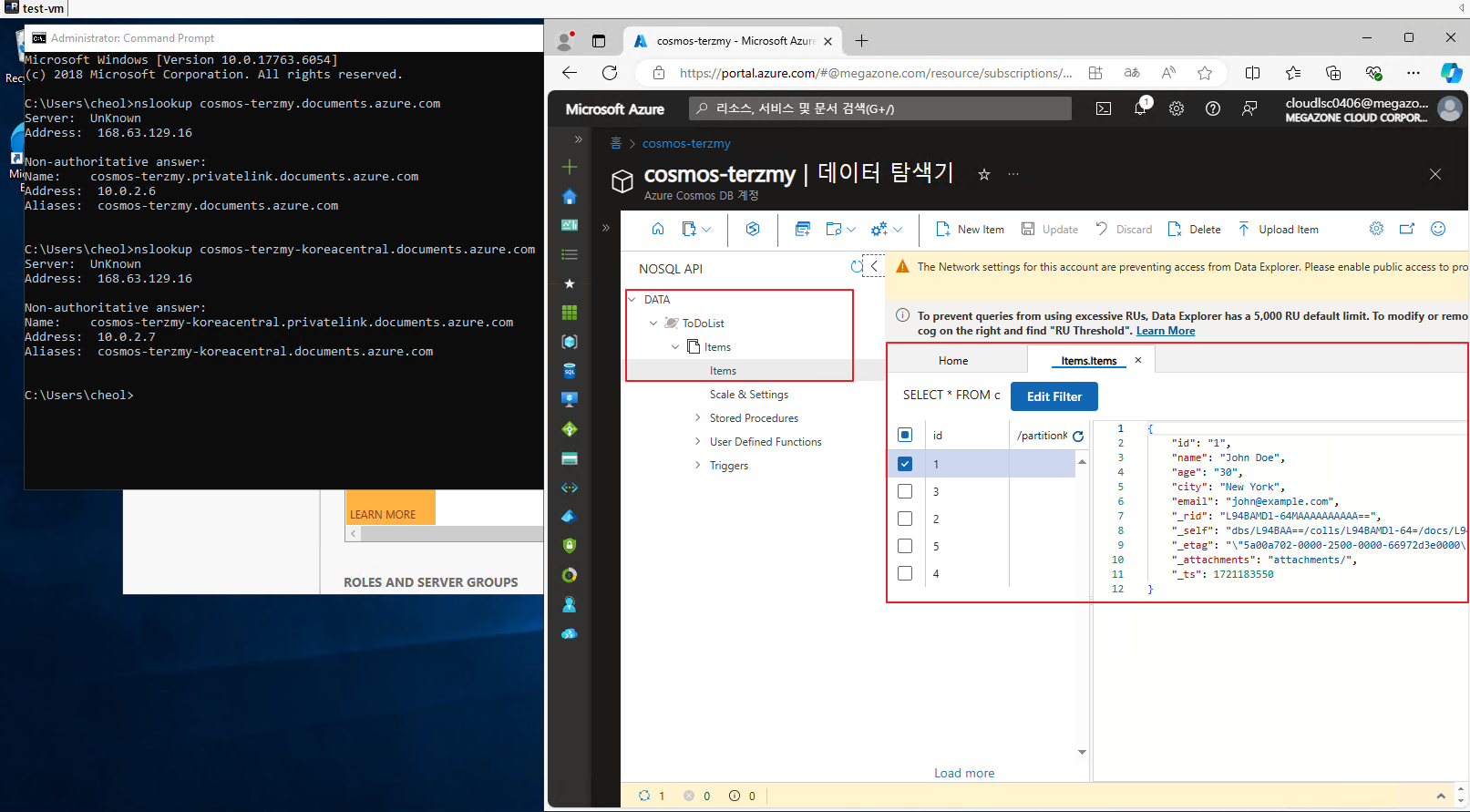

Azure VM에서 접근을 진행해보았다.

Portal에서도 정상적으로 접근이 되고 (데이터는 아직 없다) nslookup 테스트를 통해 정상적으로 Private endpoint 통신이 되는 것을 볼 수 있다.

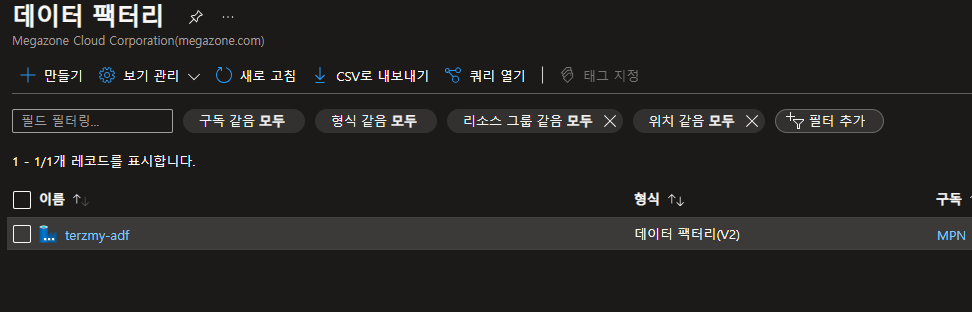

- Azure DataFactory 배포 및 구성

ADF에서 Blob Storage로 Linked Service 만들

ADF에서 CosmosDB로 Linked Service 만들기

통합 런타임 (Managed Virtual Network Azure IR)을 통해 연결하도록 설정한다.

Linked service 만드는 과정에서 Managed Private endpoint로 새로 만들기를 진행한다.

생성된 Managed Private endpoint를 확인하고 CosmosDB로 가서 승인 절차를 진행한다.

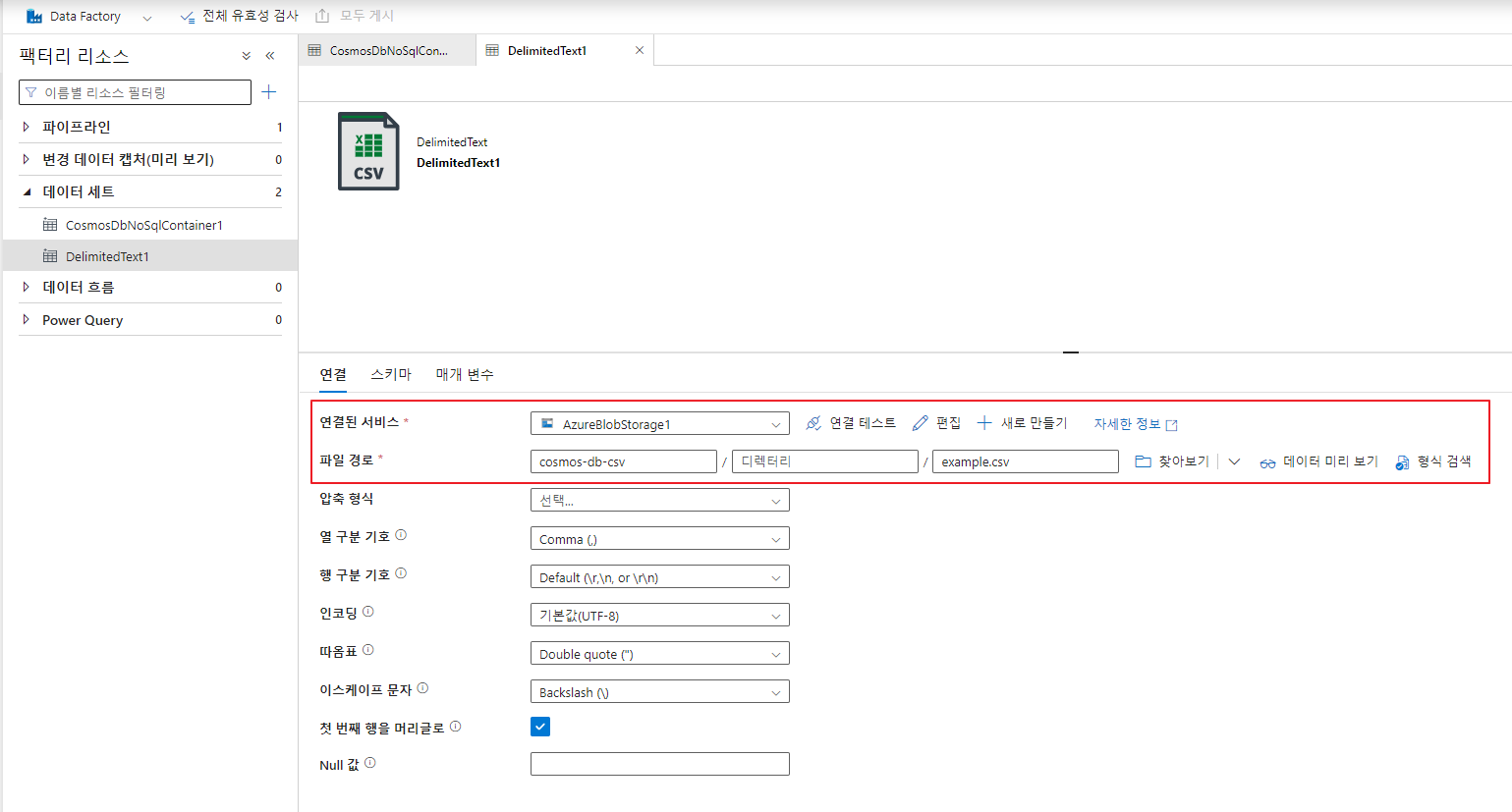

ADF 데이터 세트 구성

Blob Storage 데이터 세트 구성한다.

업로드되어있는 파일 경로를 정확히 지정한다.

Cosmos DB에 대한 데이터 세트를 설정한다.

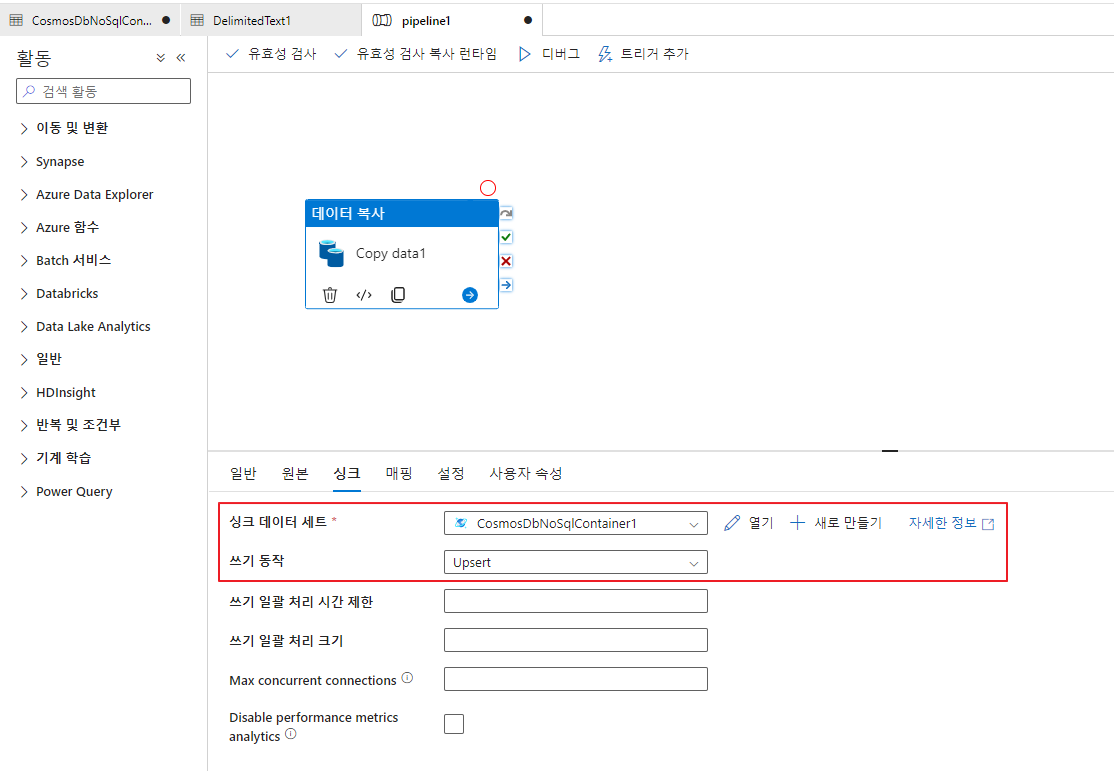

파이프라인 구축

Blob Storage에 업로드되어있는 csv 파일을 Azure Cosmos DB로 데이터를 복사하는 파이프라인 구축

4. 테스트 실행 결

파이프라인 구축 후 모두 게시를 한 뒤에 파이프라인을 트리거하여 Blob Storage CSV 파일이 Azure DataFactory를 통해 Azure Cosmos DB로 복사되는 것을 확인한다.

파이프라인 트리거 성공 결과 확인한다.

Azure Cosmos DB로 접근하여 정상적으로 데이터가 복사되어있는지 확인한다 .

정상적으로 csv 파일이 noSQL 데이터 형태로 복사되어있는것을 볼 수 있다.

'Azure' 카테고리의 다른 글

| Azure Kubernetes Service & Cert-Manager (0) | 2024.09.07 |

|---|---|

| AWS EC2(docker swarm)에서 Azure Kubernetes Service Migration (0) | 2024.07.17 |

| Private Link를 통한 Azure PostgreSQL의 Private Networking (0) | 2024.07.03 |

| [Study] Azure PostgreSQL (0) | 2024.07.03 |

| Azure Private DNS Resolver (0) | 2024.06.18 |